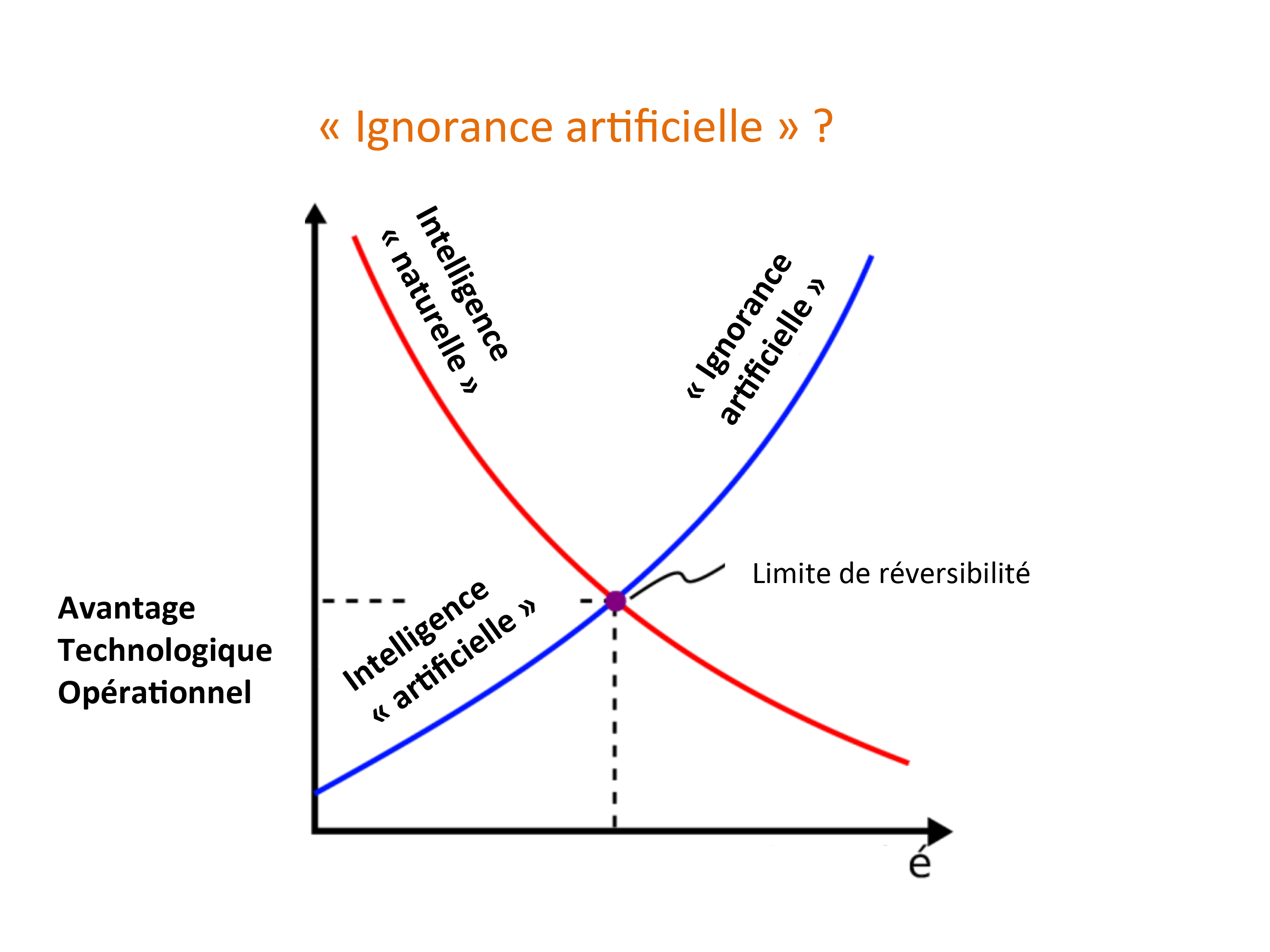

Face au changement de paradigme que représente l’inéluctable et bénéfique augmentation des capacités humaines se pose, pour le soldat, la question de sa diminution face au possible danger de l’altération de ses capacités cognitives. Notamment par la dépossession de son intelligence par une autre forme d’intelligence dite artificielle, laquelle pourrait supplanter ses capacités d’analyse et le mener vers un état d’« ignorance artificielle ».

Conclusions et mise en perspective

Conclure sur la question du soldat augmenté, après la grande richesse des articles qui précèdent est un enjeu singulier. Il y a une dimension, de clôture, de fin, d’achèvement dans toute conclusion. Alors que l’évidence nous montre avec clarté l’étendue considérable des champs ouverts par cette thématique de l’augmentation et les pistes nombreuses qu’il convient d’explorer.

Pour aborder ces réflexions, il sera proposé de prendre de manière assez caricaturale le contrepoint de la vulgate, autrement dit de partir de la position de l’avocat du diable. Deux idées seront exposées autour de deux questions qui nous paraissent inaugurales.

1. L’augmentation est un processus apprécié de façon positive, destiné à procurer une supériorité, un avantage.

2. Mais n’entraîne-t-elle pas dans son sillage, une altération des capacités propres – naturelles – de l’individu qui bénéficie de cette augmentation (artificielle) ? De ce fait, le soldat augmenté n’est-il pas aussi en corollaire, un homme « diminué » ?

Telle que nous la connaissons aujourd’hui, l’augmentation est basée sur des technologies nouvelles, soutenues par l’intelligence artificielle (IA). N’y a-t-il pas, ici encore, un risque d’affaiblissement des capacités autonomes du soldat ? L’IA ne risque-t-elle pas d’amoindrir l’intelligence propre du combattant ? Il sera proposé de décrire ce risque sous l’expression d’« ignorance artificielle » (IgA) c’est-à-dire la perte par le soldat de certaines capacités mentales en conséquence de la prise en compte d’un certain nombre d’entre elles par des processus d’intelligence artificielle.

Augmenté ou diminué ?

Le soldat diminué

Pour aborder, évidemment selon une certaine forme de provocation, ce concept d’homme « diminué », il est nécessaire de chercher quelques références dans la philosophie schumpetérienne (1), notamment son célèbre axiome d’innovation destructrice. Ainsi il peut être proposé, selon cette vision philosophique, que l’augmentation du combattant (l’innovation), comprend, de façon consubstantielle une part de diminution (de destruction) de ses capacités naturelles. Le propos paraît simpliste voire caricatural et il impose d’être explicité quelque peu.

Si les capacités de perception du combattant sont augmentées par la technologie, quid de ses aptitudes naturelles résiduelles ? Quid de la cognition propre quand elle devient augmentée, donc manipulée par la technologie ? Quid de la résilience du soldat quand ses mécanismes entrent en interférence avec quelque technologie de l’augmentation ? (2)

Dans une hypothèse voisine, que restera-t-il des capacités opérationnelles du soldat de demain, s’il perd, en totalité ou partie, ses capacités d’augmentation ou en devient dépourvu par quelque défaillance technique ?

Sera-t-il seulement à même de continuer à combattre ?

Pourrions-nous aller jusqu’à parler de résilience technologique ? Ou même encore de résilience de l’augmentation ? C’est-à-dire de cette capacité singulière, qu’il faudra bien aborder à un moment ou un autre, qui sera celle du combattant de demain, dépourvu pour diverses raisons de façon brutale des outils d’augmentation (ou de leur fonctionnement) et qui devra malgré tout continuer à assurer sa mission opérationnelle, le combat ?

Pour prendre un vocabulaire marxiste, il y a bien ce que cette philosophie établissait : un processus d’aliénation de l’individu-combattant. Cette aliénation prend ici la forme de l’incapacité opérationnelle car le soldat, le groupe, le commandement risquent de plus savoir, vouloir ou pouvoir fonctionner sans le support de la technologie d’augmentation. C’est ce que nous connaissons tous intuitivement quand nous oublions notre téléphone portable à la maison le matin. N’est-ce pas du désarroi et une incapacité profonde que nous ressentons dans ces moments-là ? La technologie nous aurait donc bel et bien aliénés.

Pour conclure sur ces points, il semble opportun de choisir un exemple extrême. Le combattant d’aujourd’hui est et demeure un homme, de chair et d’os, dont le corps est in fine son principal système d’arme. Cet homme devient augmenté, c’est-à-dire qu’on lui adjoint des technologies internes ou externes améliorant ou remplaçant ses aptitudes naturelles. L’augmentation les porte vers des niveaux de fiabilité et de précision très supérieurs à ce qui peut être espéré des aptitudes naturelles. Dès lors la tentation sera grande d’étendre le plus possible les augmentations pour rendre le soldat augmenté proche de la perfection, c’est-à-dire asymptotique de l’efficacité combattante optimale, parfaite. Que restera-t-il de l’homme « être humain » dans cette hypothèse, le simple vecteur fragile d’une carapace d’équipements le protégeant et en même temps assurant de multiples capacités automatisées ?

Sera-t-il un soldat « embarquant » un ou des systèmes d’armes réalisant l’augmentation, ou bien sera-t-il réduit à n’être qu’un acteur embarqué d’un système d’armes hypersophistiqué, constituant de ce fait sa justification ? À l’extrême, l’augmentation fait donc passer du stade du cobot (la machine assiste l’humain, le combattant) au robot (la machine fait tout, l’homme, le soldat disparaît en tant que tel) et l’on sait que l’on entre, ce faisant, dans le domaine risqué des armes létales automatiques.

Le robot, c’est la somme de toutes les augmentations possibles. C’est l’agent combattant idéal, dépourvu des fragilités humaines, dépourvu (en principe) d’émotions, de conscience, d’états d’âme. Cette hypothèse n’est pas si extrême, l’exemple des drones montre que « déshumaniser » un système d’arme présente de nombreux avantages. Là encore, la science-fiction nous offre de multiples exemples d’armées de cyborgs. La logique du soldat augmenté nous y conduit sans doute.

Il n’est pas question de tomber dans la sinistrose de tous les Cassandre de l’intelligence artificielle qui envisagent un monde où l’homme n’existe plus, relégué par les robots qui domineraient le monde, à un statut d’esclave asservi. Si ce spectre émerge, il faut en voir le côté positif. Il interroge sur un salutaire débat. Celui qui examine la place de l’homme par rapport à la machine, de la conscience (humaine) par rapport à l’algorithme et in fine au cœur du sujet, la place de l’intelligence artificielle par rapport à l’intelligence humaine naturelle. Les innombrables problèmes humains, sociaux, éthiques et juridiques posés par ce sujet ont déjà commencé à être étudiés avec rigueur tant les enjeux sont colossaux.

Soldat augmenté ou citoyen augmenté en uniforme ?

Ce questionnement pourrait sembler trivial s’il ne permettait de dégager la problématique de la supériorité sociale de certains par rapport à d’autres.

En effet, partons du postulat (presque athénien dans sa conception de la démocratie) que le soldat est un citoyen en uniforme. Le citoyen bénéficie de nombreuses technologies d’augmentation, et la progression de ces dernières, pour le commun des mortels semble bel et bien exponentielle. De ce substrat social vont émerger des femmes et des hommes qui vont s’engager sous l’uniforme, pour devenir militaires, c’est-à-dire soldats, amenés à combattre. Ces militaires vont donc disposer des progrès de l’augmentation technologique disponible pour tout citoyen. Mais ils vont disposer (en plus), de l’augmentation spécifique liée à leur métier (3), du reste souvent en avance par rapport à celles disponibles pour Monsieur Toutlemonde. Pour autant faudra-t-il considérer que ce seront des sur-citoyens, des surhommes, car disposant de capacités et technologies (augmentation) leur offrant une supériorité réelle et des pouvoirs exorbitants par rapport à la population générale ?

Ce débat peut sembler inopérant et vain. En effet, en quoi serait-il différent de la situation actuelle, où le militaire dispose déjà de moyens humains et techniques considérables qui lui offrent une « sécurité » supérieure à celle de tout citoyen ? Le soldat dispose en propre de moyens de connaissance, d’anticipation, de protection et d’action bien supérieurs (et pour beaucoup lui étant strictement réservés). Il est détenteur de facto d’un avantage considérable souvent résumé sous l’expression « maîtrise de la force ». Le cadre d’emploi des forces, et les règles d’engagement, la déontologie militaire, sont les outils privilégiés de la régulation de cette dissymétrie de moyens.

Mais allons plus loin. Considérons le soldat comme simple être humain, c’est-à-dire dépourvu de toute technologie « mécanique » ou numérique, et donc nu. A priori, il serait à égalité totale avec le simple citoyen. Or, si l’on considère certaines possibilités d’augmentation, notamment chimiques et pharmaceutiques, et en évitant bien sûr le fantasme des augmentations génétiques ou génomiques, il est fort à parier, que demain, une certaine différence à l’avantage du soldat existera car ce dernier bénéficiera de techniques pharmacologiques et de moyens biologiques supérieurs à ceux du civil. Cette tendance est déjà enclenchée, et de nombreux auteurs se sont engagés dans les salutaires réflexions portant sur la thématique, essentielle à notre sens, du soldat augmenté, surhomme, caste supérieure dans une société démocratique, et des risques inhérents à laisser se développer trop loin ce clivage social. D’évidents mécanismes de contrôle, éthiques, déontologiques et juridiques sont à mettre en place, sans tomber dans les dérives d’une vision apocalyptique à la façon de la science-fiction.

La dynamique de l’augmentation

Osons ici entreprendre un parallèle avec les théories macro-économiques. Il semble que la thématique qui nous occupe peut s’apparenter avec la classique relation entre l’offre et la demande dégagée par l’économiste Alfred Marshall (4). La demande c’est l’augmentation du potentiel du soldat, l’offre ce sont toutes les techniques et technologies qui vont permettre de répondre à cette demande (figure 1). Dans les représentations classiques, ce sont deux lignes qui se croisent, figurant le fait que plus la demande croit, plus l’offre diminue (et en symétrique, plus l’offre est massive, plus la demande s’effondre). Dans la théorie classique c’est une sorte de « main invisible » qui régulerait offre et demande pour aboutir à une forme d’équilibre égal entre les deux facteurs.

Il découle de cette théorie deux conséquences majeures pour notre propos :

• La première est que si le soldat est augmenté, ce n’est le plus souvent pas lui qui demande l’augmentation, ce sont les chefs militaires et politiques qui instrumentent l’aspect « demande » en vue de garder l’avantage stratégique, opératif et tactique. Ne pas suivre les évolutions technologiques (donc de l’augmentation) reviendrait à placer le pays et ses combattants en situation de retard voire de déclassement. Le risque évident est ici, bien plus dangereux que l’inversion du rapport de force, clé du succès tactique. Certains auteurs ont montré la part de l’individu dans la demande (5).

Outre les comportements individualistes revendiquant la liberté et le libre arbitre touchant tous les citoyens et moins les militaires, il est patent que quelques soldats refuseraient d’être augmentés pour diverses raisons. On peut penser que la perte de contrôle et d’initiative propre, serait une raison de refus majeure à côté des nécessaires efforts d’accoutumance et d’apprentissage de la technologie d’augmentation. Il y aurait sans doute également pour certains des phénomènes de crainte, de peur, pour soi, pour sa santé, risques de séquelles ou d’effets secondaires qui amèneraient des refus d’emploi des technologies rendant « augmenté ». On a mal à imaginer ces comportements aujourd’hui pour un soldat engagé à servir. Mais qu’en sera-t-il demain quand les augmentations seront majeures, quand les réflexions sur leur « nocivité » toucheront tous les individus et que le principe de précaution continuera à étendre, y compris chez les soldats, les comportements d’abstention ou d’évitement ?

À l’opposé, s’augmenter volontairement, c’est-à-dire être le meilleur, être supérieur, pouvoir se surpasser, surpasser les autres, briller, flatter son ego, etc. sont des traits de la psychologie humaine parfaitement courants qui pourront très facilement être soutenus par le dernier cri de la technologie (d’augmentation). Oui, il est très probable que du côté des soldats et de leurs chefs émergent des « geeks » de l’augmentation.

On sait (dans le domaine économique encore) que ce sont de puissants stimulants de la demande. Disposer du meilleur pour soi, pour être « au-dessus », ou pour le moins remarqué et remarquable, est le plus solide moteur des motivations d’achat des individus qui veulent se démarquer du groupe, y apparaître sinon différents au moins supérieurs. Si ce levier peut être considéré comme salutaire pour le monde marchand, il porte en termes de sociologie, un risque majeur pour le groupe, il crée des hiérarchies, des clivages. Pour toute communauté militaire ces différences mettraient en péril la cohésion. Or, depuis longtemps, la puissance militaire est bâtie autour de la forte cohésion du groupe et l’absence de singularisation. Par exemple, comme son nom l’indique l’uniforme y remédie très bien, tout comme les équipements homogènes pour les unités. Pour revenir à notre propos, on imagine très mal une unité combattante où certains seraient augmentés et pas d’autres…

Fig. 1 : « Ignorance artificielle ? »

Fig. 1 : « Ignorance artificielle ? »

• La seconde conséquence se situe du côté de l’offre. Ce sont bien sûr les chercheurs et les industriels, par leurs propositions qui créent l’offre. Il n’est point besoin d’épiloguer sur l’impérieuse nécessité pour les entreprises d’innover et de proposer de nouveaux produits pour rester compétitives.

La loi de Moore (6) faisant son œuvre exponentielle du côté des supports matériels logiques, la rude compétition des entreprises et les parts de marché feront le reste pour proposer une offre abondante et sans cesse renouvelée.

Quel que soit l’angle d’analyse, offre ou demande, le soldat, le combattant est en principe dépossédé de tout choix, même si parfois il lui semble en être l’expression. En fait, il se rallie à la technologie nouvelle qui lui est proposée. Ce faisant, il est non seulement déresponsabilisé, mais de surcroît il abandonne à l’offre technologique qui le rend « augmenté », une part fondamentale de ses capacités propres. Et c’est précisément cet abandon qui le rend doublement « diminué ». Il n’a pas eu le plus souvent le choix de son mode d’augmentation, et ce dernier lui est in fine imposé par la hiérarchie.

Ici encore ; il nous semble requis de faire un détour du côté de la sociologie et des travaux de John Robinson et Geoffret Godbey (7). Ces sociologues américains ont montré l’impact d’une nouvelle technologie (la machine à laver le linge) sur la vie des ménagères dans les années 1960. Il était communément admis que l’introduction de cette nouvelle technologie allait libérer la femme de tâches ingrates et chronophages. Or, le temps gagné (plus de deux heures) a en fait été utilisé par ces femmes non pour elles-mêmes, mais occupé à d’autres tâches ménagères. De nombreux travaux ultérieurs ont confirmé cette tendance sociologique : le temps libre, le temps gagné, est utilisé à « perte » et, au pire, comblé par du temps administratif créé de toutes pièces.

Si l’on admet que l’expérience de la machine à laver constituait une analyse des effets d’une augmentation (meilleure efficacité dans le lavage, gain de temps, simplification cognitive, économie de ressources, etc.), il semble légitime d’imaginer à partir d’elle ce qu’il pourrait advenir au soldat de demain. Si l’augmentation aboutissait in fine à deux effets antagonistes ? Bien évidemment la meilleure efficacité opérationnelle, avec des gains de temps, d’énergie, de ressources humaines, etc., mais également le comblement de tous ces espaces de liberté gagnés par un temps « non opérationnel » voire administratif (par exemple enregistrer et transmettre les indicateurs de performance de mon système d’arme augmenté…). Dès lors n’est-il pas légitime de questionner la relativité du gain issu de l’augmentation et de sons sens ?

L’Ignorance artificielle (IgA)

Peu refuseront d’admettre que les technologies de l’augmentation reposent en majorité, sinon en totalité, à un moment ou à un autre sur quelque algorithme.

L’algorithme, c’est l’essence même de ce que la communauté scientifique nomme de façon habituelle l’intelligence artificielle.

L’algorithme, c’est la pensée d’un autre, ou de plusieurs intelligences réunies. C’est aussi le résultat d’analyses de robots logiques dédiés à cette tâche puisant leur rationalité dans les fameux lacs de données… Tout est in fine transformé en équations, et s’achève en processus numériques. Cette intelligence artificielle n’est plus « humaine ». Ce n’est surtout plus « la mienne » en ce sens qu’elle échappe à « mes » propres modes de représentation, donc d’analyse d’un événement, d’une difficulté, d’une situation. Elle aboutit à une perte de mon sens du jugement.

L’IA donne donc une représentation construite artificiellement d’une réalité qui échappe à son propre jugement. Elle procure performance, avantage opérationnel, rapidité, efficacité, sécurité. C’est incontestablement une augmentation majeure. Le psychologue affirmerait que cet avantage devient palpable pour l’individu au point qu’il lui procure sentiment de puissance, de supériorité, fierté, orgueil mais aussi plaisir et une forme de jouissance.

Mais ce que le soldat grisé par la technologie augmentée de son nouvel équipement ne voit pas, c’est que cette intelligence technologique n’est plus la sienne. Elle le place sous sa tutelle. Il lui abandonne bien volontiers, parfois sans s’en rendre vraiment compte, nombre de taches cognitives ou réflectives qui l’encombraient. Il faut convenir qu’il perd ce faisant un certain nombre de savoir-faire ou de capacités sensorielles « naturelles », certes moins performantes, mais qui étaient siennes.

Il peut donc être posé ici, que le danger qui le guette (comme nous tous du reste) c’est celui qu’il est proposé de nommer « ignorance artificielle ». Tentons-en une définition : si comme le dit l’encyclopédie Larousse l’IA c’est « l’ensemble de théories et de techniques mises en œuvre en vue de réaliser des machines capables de simuler l’intelligence », dès lors il est possible de proposer que l’ignorance artificielle soit l’altération des capacités intellectuelles et cognitives propres (naturelles) de l’être humain consécutive de leur simulation, suppléance ou remplacement par l’intelligence artificielle. La recherche de cette idée ou de ce concept dans la littérature scientifique ou de vulgarisation est vaine. L’expression apparaît à peine dans les travaux fondamentaux relatifs à l’intelligence artificielle. Et encore, c’est uniquement pour servir de substrat à toutes les questions relatives à l’incertitude et l’imprécision dans la construction des algorithmes.

Cette absence théorique de l’ignorance dans le domaine de l’intelligence artificielle, donc dans celui du soldat augmenté, montre à notre sens, la grande confiance, peut-être aveugle, peut-être exagérée que nous avons dans l’intelligence artificielle. Seules quelques publications récentes (Elon Musk, Bill Gates, Stephen Hawkins (8)), assez apocalyptiques du reste, prédisent la fin de l’homme dépossédé de toute conscience par l’intelligence artificielle. Certaines critiques émergent également du côté des penseurs de la Silicon Valley, mais c’est davantage pour dénoncer l’hégémonie de l’IA et pour promouvoir le transhumanisme que pour mettre en exergue la perte consubstantielle de capacités réflectives propres que nous nommons ici ignorance artificielle.

Du reste, la littérature scientifique relative à l’IA et ses risques ne montre que les potentiels effets dévastateurs d’un monde « tout numérique », comme si ce monde, et les technologies de l’IA, était « à côté », externe à l’homme être de chair. Il n’est pas ou très peu montré les effets de l’IA sur le développement de l’intelligence naturelle, par exemple chez l’enfant, les effets sur le développement puis sur le fonctionnement cérébral, les retentissements sur les capacités naturelles du cerveau : sont-elles augmentées elles aussi, ou comme nous le suggérons, subissent-elles une perte, ce que nous nommons ignorance artificielle ? Tout ce que notre intelligence naturelle, supplée par l’IA, n’apprendra plus, ne saura plus et ne pourra plus réaliser…

La perte se porte, à notre sens, ailleurs que sur la performance intellectuelle brute. Elle concerne ces qualités essentielles que sont l’adaptabilité et l’agilité. Et il ne sera pas fait ici mention de l’intelligence émotionnelle, largement théorisée dans les théories de l’IA comme capacité de « conscience » de l’IA. Là encore, la science-fiction nous offre des archétypes, comme Terminator, robot tueur qui finit par s’humaniser en prenant « conscience » de certaines réalités. Cette notion de conscience (du soldat) nous paraît cardinale. Gödel avait très bien montré, avec son célèbre théorème d’incomplétude (9), que le cerveau humain est toujours capable de produire un système (il parlait de « déclaration ») impossible à résoudre par une machine (elle ne sera pas en mesure de le prouver). Il avançait que seule la conscience (naturelle) permet d’entrapercevoir les voies de solution. Il a voulu poser que la détermination correcte de la vérité (ou sa fausseté) d’un raisonnement ne peut être fondée que sur l’esprit humain, donc que ce dernier ne peut être réduit à un simple processus mécanique. La célèbre expérience de Turing (10) lui donne raison, jusqu’à ce jour du moins… Sur le versant militaire, un Clausewitz, aujourd’hui, dirait sans doute la même chose : la machine (IA) n’est pas en mesure de prendre « conscience » du brouillard de la guerre, et seul l’esprit du soldat, du stratège peut appréhender l’insoluble.

Pour dépasser le strict cadre de l’individu, du soldat augmenté et tenter d’aborder la problématique de l’ignorance au sens collectif, c’est-à-dire d’une organisation militaire, il paraît nécessaire de rapatrier cette fois non seulement l’économie mais aussi la stratégie, c’est-à-dire la théorie de l’avantage marginal. Les grands stratèges d’entreprise ont consacré depuis longtemps, en vertu du principe de l’offre et de la demande, le fait que la stratégie gagnante ne se décline que selon deux occurrences ; soit la technologie (qui soutient l’offre et provoque la demande) est en avance d’au moins 10 % par rapport aux technologies existantes, soit elle est 10 % moins chères.

Les stratèges militaires introduisent quant à eux le rapport de force, notion qui impose également un avantage marginal conséquent face à l’ennemi pour espérer le succès. Chacun sait qu’un bloc, une chaîne, ne tient et ne vaut que par son composant le plus sensible ou son maillon le plus faible. À n’en pas douter, demain un groupe de combat « augmenté » ne vaudra que par le soldat le moins augmenté du dispositif.

Il faut ici marquer un temps d’arrêt. La littérature sur le sujet ne parle que du soldat augmenté, et parfois s’aventure un peu à aborder la question du collectif, vu uniquement sous le prisme d’un groupe plutôt hyperhomogène de soldats augmentés. Mais s’est-on posé la question du groupe en tant que tel, entité sociale combattante et augmentée ? S’est-on posé la question du chef ? Où trouver trace du concept de « chef augmenté » ? Cette question prend un tour nouveau quand on sait par ailleurs l’importance considérable de l’IA dans les processus de prise de décision (et dans la connaissance et l’anticipation qui en sont les précurseurs essentiels !). Admettons qu’il existe là, un espace considérable non encore analysé en tant que tel mais qui nous semble absolument fondamental. Juste un sujet pour les stagiaires de l’École de Guerre : quid de l’intelligence artificielle d’un état-major ? Quid de l’intelligence artificielle du chef militaire ?

Pour finir sur ces points, il convient à présent d’évoquer un autre aspect du collectif opérationnel contemporain. En effet, à différents niveaux du reste, il devient d’usage, que ce dispositif opérationnel déployé soit multinational. Comment dès lors sera garantie la cohérence de l’augmentation des soldats, pris individuellement et collectivement, croisée avec les cultures et technologies d’augmentation différentes selon les nations participantes ?

Serons-nous en mesure, avec nos seules capacités nationales, de maintenir pour les soldats français, les moyens de bénéficier des technologies d’augmentation nécessaires pour demeurer dans la « cour des grands », des Nations qui possèdent et maîtrisent ces technologies innovantes et imposeront leurs standards d’augmentation ? En parallèle, pourrons-nous accueillir dans nos dispositifs opérationnels des alliés « non augmentés » ? Il n’y a aujourd’hui évidemment aucune réponse définitive à ces questions mais elles méritent d’être examinées.

Enfin, loin du domaine de cet article, l’augmentation technologique, en tant que capacité d’ingénierie et industrielle nationale, avec son très fort potentiel d’innovation, vient interférer avec celle de la Base industrielle et technologique de défense (BITD) et de sa nature nationale stricte ou partagée et communautaire. Le dynamisme et les investissements qui seront consentis en seront la clé, car à n’en pas douter, là où se trouvent les start-up dans le monde, là vont s’écrire demain les pages de l’augmentation technologique du combattant.

Éthique de l’augmentation

On ne peut conclure ces trop brefs développements, sans évoquer les champs de l’éthique et de la philosophie (11).

Il n’est pas question d’exhumer le fameux « science sans conscience n’est que ruine de l’âme » de Rabelais, mais la tentation est grande de le paraphraser en disant « augmenter sans conscience n’est que ruine du soldat ». Ces réflexions sont tout autant indispensables que celles purement scientifiques ou techniques portant sur les grandes avancées technologiques émergentes. Dans ce champ, le transhumanisme est à lui seul un thème enthousiasmant à décliner pour le soldat.

Depuis Asimov, la science-fiction a fait les choux gras d’une vision du soldat de demain, sorte de clone décérébré, quasi-robot dont la supériorité ne tient que par ses capacités augmentées par rapport au citoyen standard. Il y a juste 20 ans, le film Bienvenue à Gattaca nous montrait déjà les risques d’un monde où l’augmentation irait jusqu’à la sélection génomique des plus aptes. N’oublions pas que Voltaire avait déjà identifié ce risque chez les soldats 5 pieds 6 pouces du roi Fréderic II de Prusse dans son Candide.

Loin des prouesses technologiques, des années de recherches, des technologies brillantes, des systèmes d’armes ultrasophistiqués l’ennemi qui fait face aujourd’hui aux armées occidentales n’est souvent qu’un homme « nu », dont l’équipement militaire se réduit à un pick-up du commerce, une paire de sandales dépareillées et une Kalachnikoff, ou pour le moins avec des moyens rustiques et rudimentaires, comme le montre la triste série des derniers attentats terroristes à l’arme blanche ou au camion bélier. Cet exemple illustre à lui seul le paradoxe du progrès, faut-il augmenter, entrer dans une course technologique effrénée, rechercher le plus vite, plus haut, plus loin ?

Le progrès de l’augmentation ne porte-t-il pas en lui un nouveau risque d’escalade comme jadis la course à la conquête de l’Espace pendant la guerre froide ? L’histoire des hommes, des armes et de la guerre nous donne une première réponse. La course technologique est non seulement inévitable, elle est également bénéfique. Les technologies militaires, nous le savons ont inauguré et généré des milliers de technologies civiles. Mais sommes-nous d’accord pour admettre que l’augmentation introduit des questionnements d’une ampleur nouvelle ?

Sans doute, devrions-nous, collectivement, penser un nouveau paradigme, celui d’une révolution majeure où l’homme, qu’il soit combattant ou pas, sera augmenté et dans lequel les principes fondamentaux de notre civilisation, entendons par là liberté, égalité et fraternité, devront être réexaminés à l’aune des technologies qui vont les impacter fortement. Sans lyrisme, notre avenir commun, celui de nos enfants, c’est peut-être bien, et toujours, l’homme nu, dans son humanité non augmentée, mais parfaite à bien des égards. Il faudra sans doute encore plus demain lui réserver la place appropriée en face de technologies exponentiellement croissantes qui vont modifier son rapport aux autres et à son environnement tout autant que son existence propre. Il faudra développer de spécifiques mécanismes de contrôle, éthiques, déontologiques et juridiques sans tomber dans les dérives d’une vision apocalyptique ou trop précautionneuse.

* * *

Ces réflexions sont absolument essentielles et très excitantes car détentrices de réelles nouveautés, porteuses d’innovations majeures et constituent le substrat fondamental du vrai changement de paradigme que représente l’augmentation des capacités humaines. Resteront les défis majeurs de vouloir, de savoir et de pouvoir les adapter au soldat de demain ! ♦

(1) Joseph Schumpeter, Capitalisme, Socialisme et Démocratie, Payot, 1951, p. 106 et 107.

(2) Cf. article supra MCS Christian Colas et du Dr Jean-Michel Le Masson traitant de la résilience du soldat augmenté (p. 217-220).

(3) Cf. les très éclairantes définitions de l’augmentation données par G. de Boisboissel et J.-M. Le Masson (p. 21-26).

(4) Alfred Marshall, Principes d’économie politique, 1906, livre III, p. 137 et suiv.

(5) Jean-Claude Kaufmann, Ego, pour une sociologie de l’individu, Nathan, 2001, 288 pages. Voir également : Gilles Lipovetsky, L’ère du vide. Essais sur l’individualisme contemporain, Gallimard, 1983, 256 pages / Le crépuscule du Devoir. L’éthique indolore des nouveaux temps démocratiques, Folio essais, 1992, 300 pages.

(6) Ingénieur électronicien, Gordon Moore publie en 1965 dans le magazine Electronics une « loi » empirique montrant que la puissance des semi-conducteurs doublait et doublerait tous les 2 ans. Exacte, cette loi et sa cinématique exponentielle est désormais abondamment utilisée par la presse pour vulgariser le fait que la puissance des ordinateurs, leur capacité ou leur vitesse de fonctionnement double tous les deux ans.

(7) John P. Robinson et Geoffrey Godbey, Time for Life. The Surprising Ways Americans Use Their Time (2nde édition), Paperback Edition, 1999, 424 pages.

(8) Elon Musk, conférence, association nationale des gouverneurs américains, 15 juillet 2017 (www.youtube.com/). Bill Gates et Mary Ann Mackin, Showing Up for Life: Thoughts on the Gifts of a Lifetime, Crown Business, 2010, 208 pages. Stephen Hawkings : interview à la BBC du 2 décembre 2014 (www.bbc.com/).

(9) Kurt Gödel, « Über formal unentscheidbare Sätze der Principia Mathematica und verwandter Systeme », Monatshefte für Mathematik, 17 novembre 1930.

(10) Test fondé sur la capacité d’une IA à imiter la conversation humaine au point de tromper un intercoluteur.

(11) Se référer aux précédents articles du professeur Dominique Lambert (p. 191-201) et du professeur Henri Hude (p. 202-208).